Was läuft schief im Internet? In den vergangenen Jahren haben sich zahlreiche Publikationen mit den Eskalationsdynamiken von Online-Diskussionen, Hate Speech und gezielten Online-Angriffen rechtsextremer Akteure beschäftigt. Sowohl auf gesetzgeberischer als auch auf diskursiver Ebene wurden Strategien entwickelt, um Hassrede und destruktives Verhalten in virtuellen Räumen zu begrenzen. Marc Ziegele und Dominique Heinbach von der Heinrich-Heine-Universität Düsseldorf empfehlen eine andere Strategie: Die guten Seiten von Diskussionen zu stärken.

Ihre Studie „Hallo liebe Community! Konstruktive Online-Debatten fördern durch bestärkende Moderation“ ist im Mai 2021 erschienen. Die Autor:innen untersuchen die Wirkung unterschiedlicher Moderationsstile und -strategien auf die Qualität von Online-Diskussionen auf den Facebook-Seiten etablierter Medien. Sie kommen zu dem Ergebnis, dass Nutzer:innen die Qualität der Diskussionen besser bewerten, den Zusammenhalt innerhalb der Community positiver einschätzen und sich enger mit der Seite verbunden fühlen, wenn die Redaktion sich mit eigenen Beiträgen in der Diskussion beteiligt und Nutzer:innen motiviert, konstruktive und respektvolle Kommentare zu schreiben.

Interaktives Community Management: Die „Empowerment-Moderation“

Als „Empowerment-Moderation“ bezeichnen Ziegele und Heinbach diese Form der interaktiven Moderation. Die beiden Kommunikationswissenschaftler:innen unterscheiden diese von einem regulativen Moderationsstil, bei dem vor allen Dingen Hasskommentare gelöscht und Hassredner:innen ermahnt werden. Empowerment-Moderation konzentriert sich auf „bereichernde Kommentare, um konstruktive Diskussionen zu fördern, statt lediglich destruktive Diskussionen zu verhindern“, betonen sie. Wie genau soll das funktionieren?

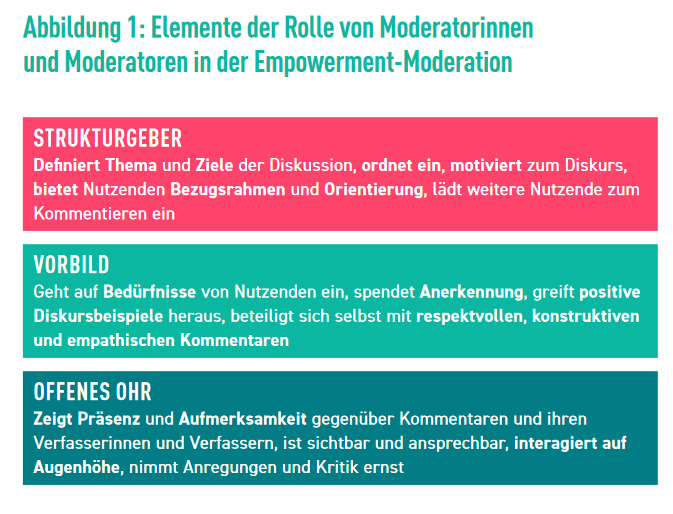

Zunächst sei es zentral, dass Community-Manager:innen Präsenz und Interesse zeigen, Gespräche initiieren und die Nutzer:innen ernst nehmen würden. Moderierende sollten sich in erster Linie als Strukturgebende betrachten, die ähnlich einer Fernsehtalkrunde durch Fragen das Gespräch in Gang bringen, Orientierung bieten, Zusatzinformationen liefern, Ziele der Diskussion benennen. Moderierende sollten hierbei eine Vorbildfunktion einnehmen, indem sie „Gefühle von Kommentierenden anerkennen sowie respektvoll und nicht herablassend oder überheblich kommunizieren“, schreiben Heinbach und Ziegele. Auf verletzenden Humor, Spott oder Sarkasmus sollte verzichtet werden.

Drei Moderationsstile für „Empowerment-Moderation“

Die Autor*innen unterscheiden für die von ihnen vorgeschlagene Empowerment-Moderation drei unterschiedliche Moderationsstile: Den kognitiven Stil, den affektiven Stil und den sozial-integrativen Stil. Der kognitive Stil soll in erster Linie den inhaltlichen Mehrwert einer Diskussion fördern, indem zusätzliche Informationen bereitgestellt, Argumente und Perspektiven präsentiert und durch Nachfragen die Expertise der Community eingeholt werden. Konkret könnten Moderierende beispielsweise in einem Eröffnungskommentar Zusatzinformationen liefern und anschließend fragen: „Wo kann man da ihrer Meinung nach ansetzen?“ oder „Was würden sie anderen Betroffenen raten?“

Der affektive Stil soll das Selbstwertgefühl der Nutzer:innen steigern, damit sie motiviert und emotional bereit sind, bereichernde Kommentare und persönliche Geschichten zu schreiben. Um diese Bereitschaft zu fördern, sei es wichtig, dass die Community sich ernst genommen und wertgeschätzt fühle. Moderierende könnten dies erreichen, indem sie einerseits ermutigende Kommentare ohne ausdrücklichen inhaltlichen Bezug verfassten („Danke für ihren Kommentar!“). Andererseits könnten sie Nachfragen: „Welche Erfahrungen habt ihr gemacht?“, „Könnt ihr das nachvollziehen?“ Anders als beim kognitiven Stil geht es bei diesem Stil also um emotionale Erfahrungen, weniger um Expertise.

Der sozial-integrative Stil setzt darauf, den Community-Gedanken zu fördern und den Austausch der Nutzer:innen zu stimulieren. Um die positive Grundstimmung im Kommentarbereich zu stärken, sollen Moderierende aktiv Gespräche anregen, Nutzer:innen miteinander verbinden sowie gemeinsame Erfahrungen und Werte betonen. Dazu gehörten dosiert eingesetzter Smalltalk, Begrüßungen („Einen guten Morgen in die Runde aus der Redaktion!“) oder Verabschiedungen. Moderierende könnten aber auch Kommentierende verbinden, indem sie auf gemeinsame Erfahrungen oder Standpunkte an anderer Stelle in den Kommentarverläufen hinweisen.

Umsetzung und Ergebnisse der Untersuchung

Um die Wirkung der „Empowerment-Moderation“ zu überprüfen, haben die Autor:innen von der Heinrich-Heine-Universität Düsseldorf diese Strategien mit 4.380 Nutzer:innen getestet. Hierzu wurden die drei Moderationsstile von vier Social Media-Redaktionen über einen Zeitraum von sechs Wochen angewendet (zwei Wochen pro Stil): Die Redaktionen von Hart aber fair, RTL Aktuell, WDR Lokalzeit Ruhr und ZDFheute haben sich an der Feldstudie beteiligt. Nutzer:innen der Facebook-Seiten aller vier Redaktionen wurden zunächst befragt, bevor die Redaktionen die Moderationsstile einsetzten. Am Ende jeder Phase des Versuchs wurden Nutzer:innen die gleichen Fragen gestellt. Sie bezogen sich vor allen Dingen auf die Wahrnehmung der Qualität von Gesprächen und Kommentaren auf den jeweiligen Facebook-Seiten.

Die Untersuchung konnte zeigen, dass die Empowerment-Moderation wirkt. Die Befragten nahmen die Kommentare auf Seiten, die Empowerment-Stile umsetzen, als rationaler, konstruktiver, weniger unhöflich und respektvoller wahr. Wie stark die gemessenen Effekte waren, hing indessen davon ab, welcher Stil gerade eingesetzt wurde und variierte auch zwischen den Seiten. So konnte beispielsweise gezeigt werden, dass sich insbesondere der sozial-integrative Stil positiv auf das Gemeinschaft- und Zusammengehörigkeitsgefühl der Communitys auswirkte.

Es ist auch wichtig, Hasskommentare zu löschen

Die Autor:innen machen eine Grenze des Konzeptes deutlich: Es gibt Kommentare, die keinen unterstützenswerten Aspekt enthalten. Insbesondere Beleidigungen und Diskriminierungen können nicht unwidersprochen im Kommentarbereich stehen bleiben. Moderierende sollten hier zunächst prüfen, ob der Kommentar strafrechtliche Relevanz besitzt oder die Netiquette der Seite verletzt. Im ersten Fall wäre eine Strafanzeige die Folge, im zweiten Fall müsste der Beitrag verborgen oder gemeldet werden. Subtilere Formen von Beleidigung oder Diskriminierung erfordern hingegen eine unmissverständliche Gegenrede der Redaktion, um die Community zu schützen.

Grenzen der Wirksamkeit

Die Studie ist ein wichtiger Beitrag, denn sie bietet Lösungen für eine breit angelegte gesellschaftliche Diskussion an, die sich zu oft ausschließlich auf die negativen Folgen der Diskussionskultur in Sozialen Netzwerken – insbesondere auf Hate Speech – konzentriert. Die Untersuchung macht deutlich, dass es wichtig ist, die positiven Stimmen in der Community zu stärken. Das ist mit Sicherheit ein Ansatz, der sich auch auf unsere gesamte Gesellschaft bezogen lohnt und hier Vorbildwirkung entfalten könnte. Doch was ist mit Seiten, auf denen diese Stimmen im Kommentarbereich gänzlich fehlen?

Die Autor:innen bieten konkrete Handlungsoptionen für Redaktionen. Viele Hinweise funktionieren aber nur auf Seiten, bei denen ohnehin ein mittleres oder hohes Kommentaraufkommen herrscht. Viele Organisationen aus der Zivilgesellschaft machen jedoch die Erfahrung, dass sie relativ wenige Rückmeldungen in Kommentarform erhalten – und davon auch noch die Mehrzahl einen negativen, gereizten oder gar menschenfeindlichen Ton anschlagen. Diese Organisation müssen ihre Community zunächst aufbauen und sind bis dahin mit negativen Rückmeldungen und Anfeindungen in den Kommentarspalten allein.

Dazu kommt: Interaktive Moderation setzt voraus, dass sich Moderator:innen mit eigenen Beiträgen in die Debatte einschalten. Doch ein solcher Moderationsstil erfordert eine Ressource, die in vielen Social-Media-Teams von Organisationen und auch Medien häufig fehlt: Zeit. In solchen Fällen dürfte es sinnvoll und nötig sein, sich auf regulative Maßnahmen wie das Löschen und Anzeigen von Hate Speech zu beschränken.

Die Studie „Hallo liebe Community! Konstruktive Online-Debatten fördern durch bestärkende Moderation“ können Sie hier downloaden.